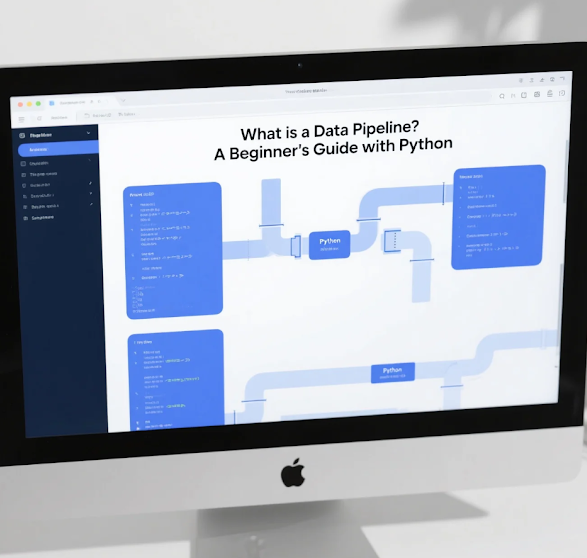

什麼是資料管線?Python 初學者完整指南

資料管線(Data Pipeline)可以是將企業級的大量資料搬移,也可以只是讓試算表與 Slack 之間自動交換資料。不論規模大小,Python 幾乎是構建這些自動化流程的最佳夥伴。本篇文章將帶你了解資料管線的基本概念、最佳實踐,並手把手建立你的第一個 Python 資料管線。

了解資料管線的基礎

資料管線是一連串自動化步驟,用於收集、轉換並傳遞資料,從一個或多個來源到最終的目的地。其典型流程包含以下幾個部分:

- 資料擷取(Extraction) — 從資料庫、API、CSV 或串流中取得資料。

- 資料轉換(Transformation) — 清理、增 enrich、重塑資料。

- 資料載入(Loading) — 將處理後的資料儲存到資料倉儲或資料庫中。

- 流程協調與排程 — 自動化整個過程。

- 監控與錯誤處理 — 確保流程穩定與正確。

其中第 1 至 3 步通常以 ETL(Extract, Transform, Load)或 ELT 的架構實現。

為什麼選擇 Python 來建立資料管線?

Python 之所以成為資料工程師的首選語言,主要因為它具備:

- 豐富的生態系:擁有 pandas、Airflow、Spark、SQLAlchemy 等強大套件。

- 高靈活性:能同時處理擷取、轉換、調度與部署。

- 可讀性高:簡潔的語法讓維護變得更容易。

- 可擴展性:可透過 Spark 或 Dask 進行分散式運算。

- 整合性強:能無縫對接資料庫、API 與雲端服務。

用 Python 建立簡易資料管線

我們來建立一個簡單的範例:

- 從 CSV 檔案擷取銷售資料

- 轉換資料,新增計算欄位

- 將結果載入 PostgreSQL 資料庫

步驟 1:擷取資料(Extract)

import pandas as pd

from sqlalchemy import create_engine

# 將 CSV 檔案讀入 DataFrame

df = pd.read_csv('sales_data.csv')

步驟 2:轉換資料(Transform)

# 將日期欄位轉為 datetime 格式

df['date'] = pd.to_datetime(df['date'])

# 新增總收入欄位

df['total_revenue'] = df['quantity'] * df['unit_price']

步驟 3:載入資料至 PostgreSQL(Load)

# 建立 PostgreSQL 連線

engine = create_engine('postgresql://username:password@host:port/database')

# 將 DataFrame 寫入資料庫

df.to_sql('sales_data', engine, if_exists='replace', index=False)

使用 Apache Airflow 進行自動化

Apache Airflow 是常見的資料管線調度工具,可以讓整個流程自動化與可視化:

from airflow import DAG

from airflow.operators.python_operator import PythonOperator

from datetime import datetime, timedelta

import pandas as pd

from sqlalchemy import create_engine

def extract_data():

return pd.read_csv('sales_data.csv')

def transform_data(df):

df['date'] = pd.to_datetime(df['date'])

df['total_revenue'] = df['quantity'] * df['unit_price']

return df

def load_data(df):

engine = create_engine('postgresql://username:password@host:port/database')

df.to_sql('sales_data', engine, if_exists='replace', index=False)

with DAG(

'sales_data_pipeline',

start_date=datetime(2023, 4, 1),

schedule_interval=timedelta(days=1),

catchup=False

) as dag:

extract_task = PythonOperator(

task_id='extract_data',

python_callable=extract_data

)

transform_task = PythonOperator(

task_id='transform_data',

python_callable=transform_data,

op_args=['{{ task_instance.xcom_pull(task_ids="extract_data") }}']

)

load_task = PythonOperator(

task_id='load_data',

python_callable=load_data,

op_args=['{{ task_instance.xcom_pull(task_ids="transform_data") }}']

)

extract_task >> transform_task >> load_task

建立可擴展管線的最佳實踐

- 平行化處理:利用 multiprocessing 或 Spark 提升速度。

- 增量載入:只處理新增資料,減少重複運算。

- 模組化:建立可重複使用的功能模組。

- 監控:整合 Prometheus 或 Datadog 監控指標。

- 容器化:使用 Docker 打包環境確保一致性。

低程式碼替代方案:Fabi.ai

如果你不想寫太多程式碼,也可以使用像 Fabi.ai 這樣的低程式碼平台,只需簡單步驟即可建立資料管線:

- 連接資料來源

- 用 SQL + Python 查詢與分析資料

- 自動匯出到 Google Sheets 或 Slack 並設定排程更新

結語

資料管線是企業自動化與洞察分析的核心。Python 擁有龐大的生態系,讓你能快速構建、排程並擴展你的資料流程。無論你喜歡親自編碼還是使用低程式碼工具,都可以從簡單開始,逐步打造屬於自己的專業資料架構。